-

데이터과학을 위한 통계 리뷰 - 13일차 (회귀와 예측,적합값과 잔차,최소제곱,다중회귀분석,OLS,RMSE,MSE,MAE,RMSLE)Machine Learning/데이터과학을 위한 통계 2021. 3. 13. 22:42반응형

4. 회귀와 예측

단순선형회귀란? 한 변수와 또 다른 변수의 크기 사이의 어떤 관계가 있는 지 보여주는 것

아들의 키와 아버지 키의 점그래프(scatter plot)

두개의 데이터는 선형관계를 알 수 있습니다.

아버지의 키가 클수록 아들의 키도 커지는 것으로 확인됩니다.

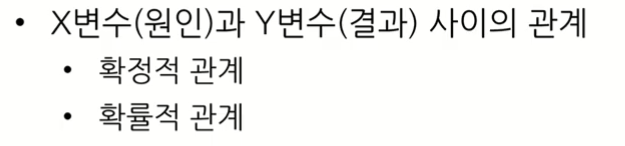

x 변수만으로 Y를 100% 표현 (오차항 없음)

x 변수와 오차항이 Y를 표현 (오차항 있음)

우리가 머신러닝을 통해서 회귀식을 알려고 하면 기본적인 회귀식을 알고 있어야 합니다.

기본적인 회귀식은 y = x*w+b 식입니다.

(독립변수*가중치)+바이어스

이 식은 추후에 딥러닝으로 넘어가서도 Keras의 Dense class와 동일한 작용을 합니다.

물론 행렬식으로 적용되기에 이런 간단한 식하고는 조금 차이가 있습니다.

다변량 데이터 예시

대체적으로 예측을 할 변수를 종속변수(y)라고 부르고,

그외 어떠한 y를 예측하기 위한 변수들을 독립변수라고 부릅니다.

간단하게 예시로 python을 이용해서 linear model을 만들어 보겠습니다.

여기서 결과값으로 나온 coef_는 계수(coefficient) 즉 기울기 입니다.

더해주는 부분이고, intercept_는 곱해주는 가중치(weight) 즉 절편 입니다.

시각화로 나타내면 이렇습니다.

예측결과도 선형을 나타내고 있습니다.

실제로 데이터를 이용해서 머신러닝을 이용하면 이렇게 이쁜 그래프는 거의 보시기 힘듭니다.

대부분 비선형 관계를 나타내는 데이터들이 많다보니, 더욱 더 복잡해집니다.

4.1.2 적합값과 잔차

•회귀식 :

잔차 : 모든 데이터가 정확히 한 직선 안에 들어오지 않기 때문에 오차항 포함

여기서, 예측된 결과값을 y^hat 이라고 부르겠습니다.

y^hat •적합값(Y^hat) : 모델이 데이터에 적합 된 결과값 = 예측값

•잔차(e ̂_i) : 실제 값 – 예측 값

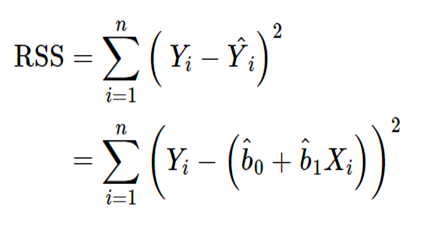

4.1.3 최소제곱

최소제곱 : 잔차의 제곱합을 최소화하여 회귀를 피팅하는 방법(유의어: 보통최소제곱)

•회귀선(regression line): 잔차들을 제곱한 값들의 합인 잔차제곱합(RSS; Residual Sum of Square)을 최소로 하는 선

최소제곱회귀(least squares regression) 또는 보통최소제곱(OLS; ordinary least squares)

즉, 독립변수가 종속변수에 어떤 영향을 끼치는지 알아내려고 하는 것이 회귀 방정식

다중회귀분석

•독립변수가 2개 이상인 회귀분석

•다중회귀 분석에서 독립변수 개수가 많을 경우 적절한 회귀모형 선택이 필요함

회귀모형에 포함되는 예측변수의 선정 기준

1.종속변수와 높은 상관관계

2.선택된 독립변수들은 서로 낮은 상관관계를 보임(다중공선성 문제를 회피)

3.예측변수의 개수는 적을수록 유리

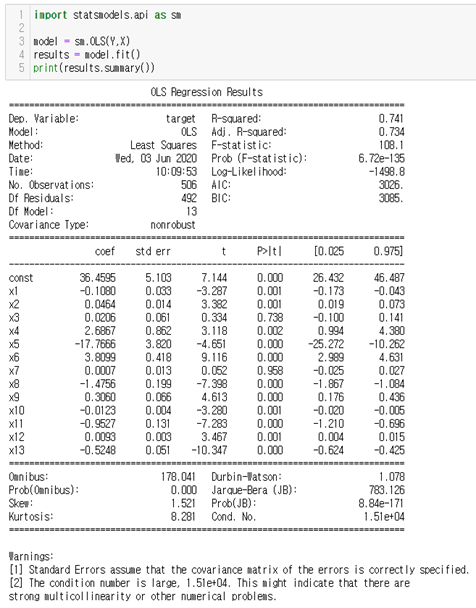

OLS 회귀분석을 이용한 선형회귀 분석방법

2021.03.10 - [Machine Learning] - 사이킷런(sklearn)을 이용한 머신러닝 - 1

사이킷런(sklearn)을 이용한 머신러닝 - 1

scikits machine Learning 잔차 :종속변수와 독립변수와의 관계를 밝히는 통계모형에서 모형에 의하여 추정된 종속변수의 값과 실제 관찰된 종속변수 값과의 차이이다. 이 차이는 오차(error)로도 해석

datacook.tistory.com

자세한 설명은 이글을 참고 부탁드립니다.

회귀식 결과 값을 검증하는 방법

분포

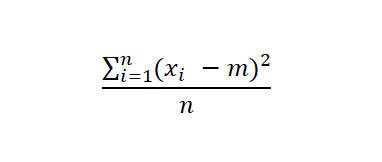

공통식

x = 관측치

m = 평균

n = 전체개수

평균절대편차

분산

표준편차

회귀

공통식

y = 실제 예측해야될 값

y^hat = 머신러닝을 통해 나온 결과값

n = 전체개수

MAE (Mean Absolute Error)

실제 값과 예측 값 차이를 절댓값으로 변환하여 평균

MSE (Mean Squared Error)

실제 값과 예측 값 차이를 제곱하여 평균

RMSE(Root Mean Squared Error)

실험이나 관측에서 나타나는 오차(Error)를 제곱(Square)해서 평균(Mean)한 값의 제곱근(Root)

RSE(Regidual Squared Error)

•RMSE와 비슷한 개념

•오차가 아닌 잔차에 대한 평가 방법

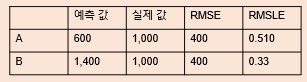

RMSLE(Root Mean Square Log Error)

RMSE에 로그를 적용

RMSE과 비교했을 때 강점

1. 이상치에 강건

2. 상대적 Error 측정

3. 하향 추정에 패널티 부여

A의 경우 예측 값이 실제 값보다 작음

èRMSLE가 더 높음

Ex) 치킨을 주문 시, 20분 걸린다고 했는데, 30분 걸렸을 때

결정계수 R^2(R Square)

분산의 설명력이 높음

분산의 설명력이 낮음

반응형

반응형'Machine Learning > 데이터과학을 위한 통계' 카테고리의 다른 글